Es sei betont: Diesen Text hat ein Mensch geschrieben, keine Künstliche Intelligenz (KI). Wichtiger als die Frage, woran man das merkt, ist derzeit wohl nur die Frage: Warum ist das überhaupt von Bedeutung? Die Antwort: Weil Menschen den Maschinen momentan noch in vielerlei Hinsicht überlegen sind. Das kann sich jedoch, da sind sich alle Computer-Experten vom Silicon Valley bis Shanghai einig, schneller ändern, als wir uns das hier und heute vorstellen können. Weltweit trainieren immer mehr Menschen KI-Systeme, um hochentwickelte kognitive Software zu schaffen, die elementare menschliche Fähigkeiten wie logisches Denken, Lernen, Planen und Kreativität imitiert – manche sagen auch: beherrscht. Doch wenn Computer erst einmal eigenständig agieren, dann lernen sie meistens exponentiell schnell.

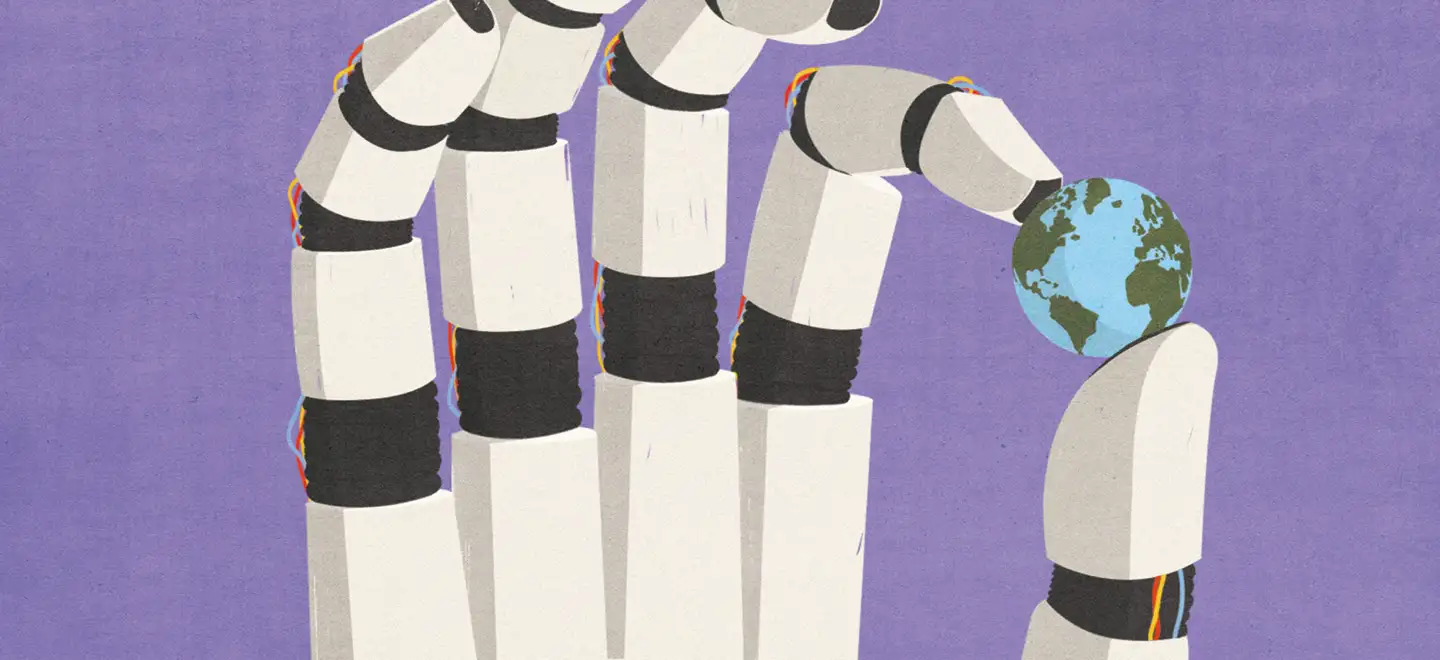

Wohin das Maschinenlernen in den nächsten Jahrzehnten führen wird, lässt sich daher nur vage erahnen. Viele sehen darin nur die logische nächste Evolutionsstufe des technologischen Fortschritts, der es sich anzupassen gilt – vergleichbar mit dem Buchdruck oder dem Telefon. Erstmals sind Maschinen jedoch nicht mehr nur Werkzeuge, sondern erschaffen selbstständig etwas. Genau deshalb ist die Furcht vor unkontrollierbaren Risiken, die Computer mit autonomen Eigenschaften mit sich bringen, besonders ausgeprägt. Selbst Experten wie Geoffrey Hinton, langjähriger Top-Entwickler bei Google, den sie im Silicon Valley „KI-Godfather“ nennen, warnen vor dem Missbrauchs-potenzial: „Es ist schwierig, sich vorzustellen, wie man die Bösen daran hindert, KI für böse Dinge einzusetzen.“ Wenn alles, bis hin zur Atombombe, computergesteuert ist, was also, wenn sich selbstständige Maschinen gegen das Wohl der Menschheit richten?

Die ersten theoretischen Grundlagen für die Technologie sowie die Bezeichnung „Künstliche Intelligenz“ stammen aus den 1950er Jahren. Damals beschäftigte sich allen voran der Brite Alan Turing, einer der einflussreichsten Mathematiker, Informatiker und Kryptoanalytiker des 20. Jahrhunderts, mit der Idee, Maschinen könnten menschenähnliche Intelligenz entwickeln. Auf der anderen Seite des Atlantiks forschte US-Informatiker John McCarthy zum Thema KI. Eine seiner Thesen: „Jeder Aspekt des Lernens und andere Eigenschaften von Intelligenz können im Prinzip so präzise beschrieben werden, dass eine Maschine sie simulieren kann.“ Parallel zu sich exponentiell verbessernden Computer-Chips wurde dann sehr lang ohne ersichtlichen Nutzen für die Allgemeinheit an KI-Systemen getüftelt. So richtig änderte sich das erst im Jahr 2023, das darum als technologischer Meilenstein betrachtet wird: Dank des Durchbruchs des KI-basierten Chatbots ChatGPT und des Nachfolgesystems GPT-4 – beide entwickelt von dem mittlerweile zu Microsoft gehörenden kalifornischen Unternehmen OpenAI – erhielten erstmals alle Internetnutzenden Zugang zu einer komplexen Künstlichen Intelligenz. Mit simplen Befehlen lässt sich nun in Sekunden Text-, Bild- und Video-Material in einer Qualität kreieren, die ohne menschliches Zutun bislang nicht möglich war. Aber werden Maschinen wirklich intelligent, sobald sie lernfähig sind und Informationen schnell verarbeiten können? Ethische Fragen wie diese beschäftigen auch die KI-Entwickler: So sagt Aleksander Mądry, Leiter der Risiko-Abteilung von OpenAI, im Dokumentarfilm „Schlaue neue Welt: Das KI-Wettrennen“: „Als Menscheit sind wir gerade gezwungen, genau darüber nachzudenken, was Bewusstsein ist.“

Inzwischen vergeht kaum ein Tag ohne neue KI-Anwendungen und -Produkte – auch in rechenintensiveren Bereichen wie Coding, 3D-Modellierung und Simulation. Wem ChatGPT nicht reicht, kann etwa Copy.ai, ChatSonic, Jasper, Lex oder Googles Gemini Ultra nutzen. Tech-Unternehmen, aber auch Staaten haben ihre Investitionen in die Technologie 2023 um viele Milliarden Euro erhöht. Computer-Experten prophezeien, dass eine Vielzahl an Bürotätigkeiten – zum Beispiel bei Medien, im öffentlichen Sektor oder in der Finanzbranche – schon bald durch KI-Systeme spürbar optimiert oder gar ersetzt werden könnte. Die Optimisten unter ihnen hoffen zudem, dass die Technologie innerhalb weniger Jahrzehnte mithelfen wird, drängende Menscheitsprobleme zu lösen – von der Versorgung mit nachhaltigen Lebensmitteln über die Heilung von Krankheiten wie Krebs bis hin zum Klimawandel.

EU BESCHLIEßT ERSTES KI-GESETZ

Die Politik versucht, Schritt zu halten: So einigte sich die Europäische Union 2023 auf ein sogenanntes KI-Gesetz und spricht von der „weltweit ersten Regelung dieser Art“. In Europa verwendete KI-Systeme sollen damit so reguliert werden, dass sie keinen gesellschaftlichen Schaden anrichten können, mit dem Ansatz: Je höher das Risiko, desto strenger die Vorschriften. Ob die EU-Leitplanken genügen, um Europa vor potenziellen Gefahren durch KI zu schützen, ist strittig. Zu unübersichtlich, rasant und vielschichtig ist die Entwicklung, zumal das Gesetz viel Spielraum lässt, um Innovationen nicht abzuwürgen.

„Die Wucht dieser neuen Revolution hat selbst diejenigen von uns überrascht, die an vorderster Front stehen“, schreibt Mustafa Suleyman, KI-Pionier und Mitgründer der Google-Tochter DeepMind, in seinem im Februar erscheinenden Buch „The Coming Wave“ (siehe auch Seite 79). Er glaubt, dass die kommende Technologiewelle die Menschheitsgeschichte an einen Wendepunkt bringen werde: „Unsere Zukunft hängt entscheidend von Künstlicher Intelligenz ab, ist gleichzeitig aber durch sie gefährdet.“